Le grand arbitrage

Les cimetières sont remplis de sociétés qui n’ont pas compris les règles du jeu.

Peter Thiel pose une question essentielle dans Zero to One : “Quelle vérité importante très peu de gens partagent avec vous ?” j’en propose une version:

Un cadre supérieur coûte environ 145 000 € par an à son employeur — salaire brut augmenté de 45 % de charges patronales. Il travaille 1 820 heures par an, prend cinq semaines de congés légaux, tombe malade en moyenne 17 jours ouvrables, résiste au changement, négocie sa promotion, change d’entreprise. Un agent Claude Opus 4.7 — le modèle public le plus avancé d’Anthropic à ce jour — coûte entre 4 000 et 20 000 € par an en usage enterprise intensif. Il tourne 8 760 heures. Il ne prend pas de vacances, il ne prend pas de place, il n’a pas de voiture de fonction…

L’arbitrage est béant. La fenêtre va se refermer — bien plus vite que le consensus ne l’admet.

Ce qu’on voit

Le consensus est limpide et répété à chaque conférence tech depuis 2023. L’adoption de l’IA en entreprise sera lente. Les organisations résistent. Les hallucinations rendent les agents peu fiables. Les projets de transformation échouent. La prudence s’impose.

Les chiffres qui étayent cette narration existent — ils ne mentent pas. Selon une enquête publiée en 2025, 42 % des dirigeants de haut niveau estiment que l’adoption de l’IA générative divise leur entreprise. Plus d’un dirigeant sur trois la qualifie de “déception massive”. Soixante pour cent des responsables IA citent l’intégration aux systèmes hérités comme obstacle principal. Selon BCG, l’usage de l’IA progresse dans les entreprises, mais l’impact mesurable, lui, stagne.

Mais ces chiffres décrivent le visible. Frédéric Bastiat, en 1850, avait nommé le problème avec une précision que cent soixante-quinze ans n’ont pas entamée : il y a ce qu’on voit, et il y a ce qu’on ne voit pas. L’économiste français appliquait ce principe à la vitre cassée — le vitrier qu’on voit travailler, le tailleur qu’on ne verra jamais prospérer. Le même mécanisme gouverne la disruption agentique.

L’inertie est réelle — mais elle n’a jamais arrêté une pression économique suffisante

L’inertie organisationnelle n’est pas une illusion. Les comités de gouvernance AI s’accumulent. Les juristes ralentissent les déploiements. Les équipes IT défendent leurs périmètres. Les projets pilotes meurent en production faute d’ontologie, de gouvernance, ou de portage politique interne. Tout cela est documenté, vécu, compréhensible.

Mais l’inertie a une limite précise : le différentiel de compétitivité. Quand un concurrent capture un avantage de coût structurel de ×10 sur un poste de dépense significatif, l’inertie ne protège plus — elle tue à retardement. Les entreprises qui ont résisté au passage au cloud entre 2010 et 2015 n’ont pas gagné du temps. Elles ont accumulé une dette technique et concurrentielle. L’histoire ne se répète pas mais elle rime…

Peu d’analystes soulignent l’origine financière précise de cette inertie. Dans un épisode récent d’Invest Like the Best (EP.466), Alan Waxman, fondateur et CEO de Sixth Street, retrace les trois grandes phases de l’architecture financière américaine depuis 1929. La première, née du Glass-Steagall Act de 1933 : la séparation stricte entre banques commerciales et banques d’investissement. La deuxième, la grande libéralisation des années 2000 : dérégulation, intégration, et in fine la crise de 2008. La troisième — celle dans laquelle nous vivons encore — est la plus déterminante pour comprendre la résistance à l’adoption de l’IA.

Post-2008, Basel III et Dodd-Frank ont redessiné les règles du jeu. Le capital s’est réorganisé autour d’un principe unique : la sécurité. Le matching actif/passif est devenu la priorité des allocateurs. Les grandes entités bien “marketées” sont devenues des proxy de sécurité pour des investisseurs institutionnels traumatisés par la crise. Les petits acteurs agiles, capables de surperformer mais incapables de garantir la masse rassurante, ont été structurellement évincés. Cette architecture financière délibérée est entretenue depuis seize ans.

L’IA va renverser cette table. Non par idéologie, mais par arithmétique. Quand l’écart de performance entre le petit agile armé d’agents et le grand inerte protégé par sa taille devient de ×5 à ×10 sur les coûts opérationnels, même le capital le plus averse au risque ne peut plus l’ignorer. Les agiles réprimés depuis 2008 ont une fenêtre — ils vont la prendre.

Les hallucinations : argument technique ou argument de confort ?

Les hallucinations sont réelles. Les agents actuels se trompent, inventent des sources, confondent des dates, produisent des sorties incorrectes dans des contextes critiques. Pour un cabinet d’avocats, un acteur financier régulé, un système médical, ce n’est pas un risque théorique — c’est une ligne rouge opérationnelle.

Mais l’argument des hallucinations, utilisé comme raison de ne rien faire, confond un problème technique en cours de résolution avec une contrainte permanente. Il existe exactement deux voies industrielles pour résoudre ce problème, les deux sont déjà déployées à grande échelle. La première : améliorer la qualité intrinsèque du modèle et de son harnais jusqu’à rendre les erreurs rares et détectables. La deuxième : contraindre l’agent dans une ontologie sémantique qui rend ses erreurs impossibles par construction. Ces deux voies ne sont pas des promesses de plan stratégique — des faits industriels observables depuis 2025, portés par des acteurs dont les revenus croissent à +50 % ou plus par an.

Ce qu’on ne voit pas

Le cas conservateur : l’arbitrage individuel

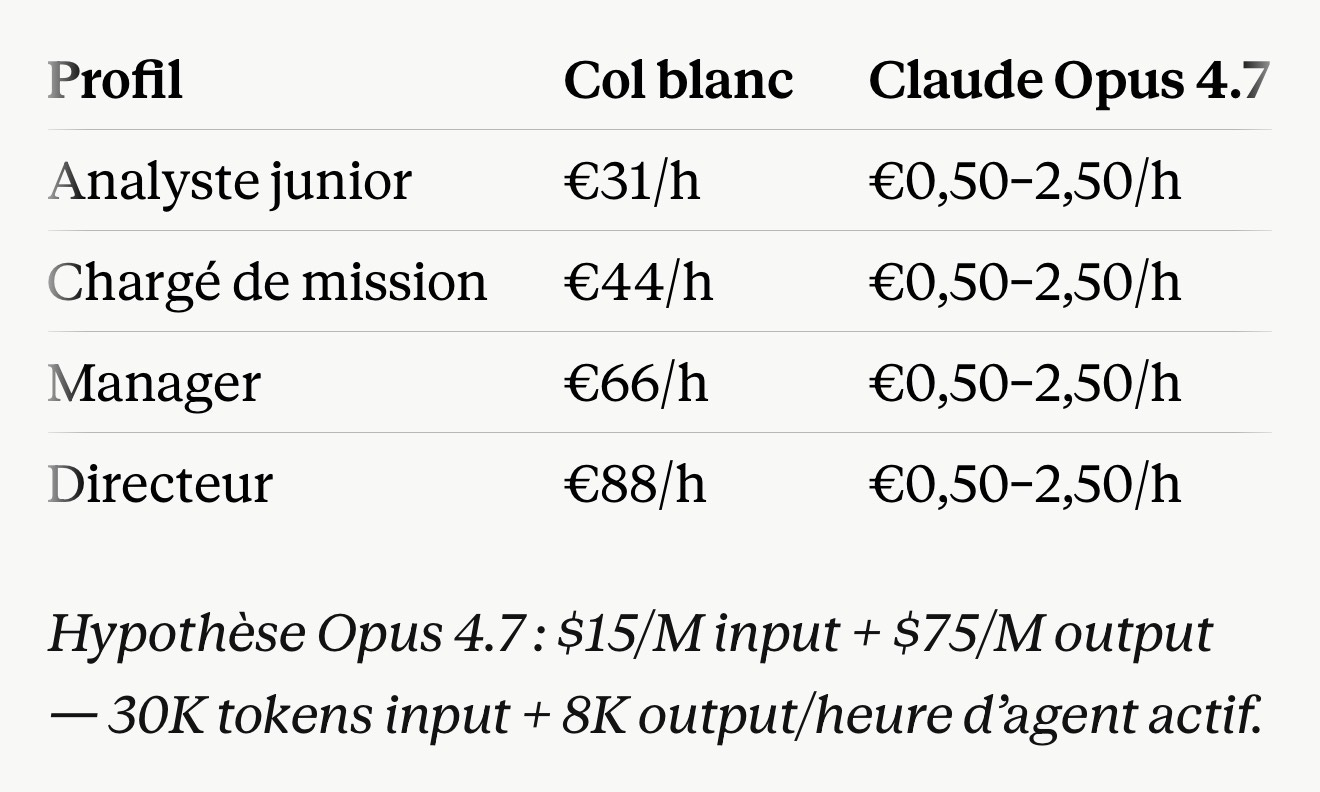

Voici les chiffres, sans artifice. Coût total employeur en France, calculé sur la base du salaire brut augmenté de 60 % de charges patronales :

Un agent Claude Opus 4.7 en déploiement enterprise intensif coûte entre 4 000 et 20 000 € par an selon les volumes de tokens traités et l’infrastructure associée. Il est disponible 8 760 heures par an — 4,8 fois plus que le salarié à 35 heures. Sa productivité ne décline pas après 18h. Le ratio coût/disponibilité atteint ×3 à ×40 selon le profil.

Mais ce tableau est le cas conservateur — celui où l’on raisonne en remplacement individuel, un agent pour un salarié.

Le cas réel : le saut superlinéaire

La réalité de l’architecture multi-agents est d’un ordre de grandeur supérieur. Un système de cent agents orchestrés en boucle — chacun diagnostiquant, remédiant, validant, documentant en temps réel — ne coûte pas cent fois le prix d’un agent seul. Le coût marginal du Nième agent tend vers zéro. Ce que ce système peut traiter, en revanche, est le travail d’une organisation entière : non pas un poste remplacé, mais une direction comptable, un service juridique, un centre d’appels, une cellule de reporting. Sur certains processus, le ratio réel n’est pas ×10 — il est ×1 000.

Ben Thompson et Benedict Evans le formulent précisément dans leur entretien Stratechery de février 2026 : faire travailler ensemble mille agents ne coûte pas davantage que d’en faire travailler un. Faire travailler ensemble mille salariés générait des coûts exponentiels — réunions, reporting, silos, friction hiérarchique — que l’agent ignore par construction. La coordination était un coût. Elle cesse de l’être. Et seuls les grands groupes suffisamment agiles pour réorganiser leurs flux autour de cette réalité pourront en capturer l’avantage — dans le monde post-2008 que décrit Waxman, c’est précisément ce que la plupart ne sont plus.

Ken Fisher : la vraie question n’est pas technique

Ken Fisher construit sa méthode sur un principe : le marché intègre ce que tout le monde voit. L’avantage vient de ce que peu voient encore.

Tout le monde voit les mêmes obstacles : hallucinations, inertie, complexité d’intégration aux systèmes legacy. Peu voient encore que ces obstacles sont transitoires, que le levier économique sous-jacent est permanent, et que le différentiel de compétitivité va se creuser de façon irréversible dès que le seuil de fiabilité sera franchi. Le cerveau fait subir aux décideurs une distorsion précise : il les pousse à surestimer la durée des obstacles visibles — et à ignorer la pression invisible du levier économique. La pression n’est pas technique. Elle est économique. L’économie, contrairement à la technologie, ne prend pas de vacances.

La guerre de l’ontologie : comment on referme la fenêtre

L’arbitrage sera saisi. La question n’est donc pas si, mais qui résoudra le problème des hallucinations — et par quelle voie, à quelle vitesse, pour quel type d’entreprise. Deux approches structurellement distinctes s’affrontent, avec une troisième qui contourne par le bas.

Palantir : l’incumbent qui a tout inventé

Palantir a résolu le problème des hallucinations avant même que le mot “agent” entre dans le vocabulaire mainstream. Son AIP — Artificial Intelligence Platform — repose sur une ontologie : une modélisation sémantique complète de l’organisation, qui transforme les données d’entreprise — processus, flux, relations entre entités — en représentations structurées et lisibles par les agents. Résultat : les agents opèrent dans un espace contraint, défini, auditable. Ils ne peuvent pas inventer ce que l’ontologie n’autorise pas.

Le modèle de déploiement est high-touch : des “Forward Deployed Engineers” travaillent sur site, chez le client, pendant des mois, pour construire cette ontologie couche par couche. Coûteux. Long. Et c’est précisément ce qui le rend défendable — la barrière à la réplication est élevée.

Les chiffres parlent d’eux-mêmes : FY2025 à 4,46 milliards de dollars de revenus, +53 % sur un an. Q4 2025 à +70 % en glissement annuel. Le segment commercial américain en hausse de +137 % grâce à l’AIP. C3.ai, son rival direct, perd des parts de marché. Palantir est aujourd’hui le quasi-monopole de l’ontologie entreprise, tout le monde l’envie.

OpenAI Frontier : le challenger haut de gamme

En février 2026, Denise Dresser, Chief Revenue Officer d’OpenAI, envoie un memo de quatre pages à ses équipes. La phrase centrale est d’une précision remarquable : “Enterprise AI is entering a more mature phase where raw capability is no longer enough. Customers want fit.” Fit — comment l’IA s’intègre aux workflows, aux données, aux contrôles et aux opérations quotidiennes du client. La définition opérationnelle de l’ontologie, sans en prononcer le mot.

OpenAI répond avec Frontier, lancé le 5 février 2026 : une plateforme enterprise d’agents dotée d’une couche sémantique partagée. Tous les agents Frontier opèrent sur un contexte business commun — CRM, entrepôts de données, outils internes — au lieu de fonctionner en silo. Clients pilotes : HP, Intuit, Oracle, Uber, State Farm. Alliances multi-annuelles avec McKinsey, BCG, Accenture et Capgemini pour le déploiement. Objectif affiché : 50 % des revenus d’OpenAI issus de l’enterprise d’ici fin 2026, contre 40 % aujourd’hui.

Un détail ? Non. La contrainte centrale du modèle Frontier : les ontologies construites par des consultants restent en grande partie manuelles, bespoke, et de qualité inférieure à ce que Palantir a industrialisé sur vingt ans de déploiements sectoriels. Déléguer la partie la plus difficile du travail à des tiers dont ce n’est pas le métier historique a un coût — en qualité, en temps, en pérennité.

Anthropic MCP : l’ontologie distribuée

Anthropic joue une troisième voie, radicalement différente. En novembre 2024, la société lance le Model Context Protocol — un standard ouvert qui permet à n’importe quel système de données de devenir lisible par un agent, via un protocole JSON standardisé. La stratégie : ne pas construire une ontologie centrale, mais fournir le standard qui permet à chaque acteur de construire la sienne localement et de la rendre accessible.

Le protocole a été donné à la Linux Foundation, co-gouvernée par l’Agentic AI Foundation avec OpenAI, Google, Microsoft, AWS et Bloomberg. En mars 2026 : 10 000 serveurs MCP publics actifs, 97 millions de téléchargements mensuels de SDK. L’ontologie sans Forward Deployed Engineers, sans budget Palantir, sans alliance McKinsey — accessible à toute entreprise ou éditeur qui publie son serveur.

Christensen au tableau

Clayton Christensen avait établi une loi : quand la performance d’une technologie n’est “pas encore assez bonne”, l’intégration verticale capte les profits attractifs. Quand elle devient “suffisamment bonne”, la modularité les disperse vers les couches adjacentes.

Anthropic intègre verticalement modèle et harnais — la qualité de l’agent est garantie par la maîtrise de la chaîne d’exécution. L’ontologie, elle, est délibérément modularisée : MCP est un standard ouvert que n’importe quel acteur peut adopter. Anthropic contrôle l’intelligence et ouvre le contexte.

OpenAI joue l’inverse. Frontier intègre le modèle et l’ontologie — la couche sémantique et le modèle forment un seul bloc contrôlé par OpenAI. Le harnais, lui, peut être modularisé : c’est dans cette logique que s’inscrit l’embauche du créateur d’OpenClaw, dont la mission est précisément de construire la couche d’orchestration externalisable. OpenAI insiste sur le modèle car il a réservé d’avantage de puissance de calcul qu’Anthropic.

Les deux acteurs intègrent là où la performance n’est pas encore assez bonne — et modularisent là où elle peut être déléguée. Ils ne se font pas la même guerre. Ils construisent deux architectures d’empire différentes.

Haro sur l’entreprise

Le pivot d’OpenAI vers l’enterprise n’est pas un calcul de portefeuille. OpenAI reconnaît lucidement la béance de l’arbitrage à exploiter. L’enterprise offre des contrats pluriannuels, des volumes prévisibles, et des décideurs qui comprennent immédiatement ce que signifie un ratio de ×1 000 sur certains processus. L’enterprise est le terrain où l’arbitrage se monétise le plus vite, le plus massivement, et avec la plus grande durabilité. La course à l’enterprise est d’abord une course à la capture de l’arbitrage — avant d’être une guerre de parts de marché logicielles.

Les SaaS sortent renforcés

L’ironie apparente de cette bifurcation, c’est que les éditeurs SaaS — présentés par certains comme les premières victimes de l’ère agentique — en sortent en réalité structurellement renforcés. Non pas malgré la transition, mais grâce à elle.

Leur portion d’ontologie — les données accumulées sur des décennies, les intégrations profondes avec les systèmes tiers, le contexte métier sectoriel construit avec des milliers de clients — devient la pièce maîtresse de l’architecture agentique. Un agent ne peut opérer sans contexte. Ce contexte, le SaaS installé le détient. Il l’a construit, souvent sans en mesurer la valeur stratégique, pendant que ses ingénieurs s’occupaient de spécifications.

La Fontaine l’avait formulé autrement. La cigale avait chanté tout l’été — empilé les fonctionnalités, amélioré les interfaces, négligé la profondeur de ses données. La fourmi avait stocké — construit patiemment une couche sémantique irremplaçable. Quand l’hiver agentique arrive, la fourmi n’a pas besoin de la cigale.

Les repositionnements sont déjà visibles. Salesforce a refondu sa plateforme autour d’Agentforce 360, adossé à Data Cloud — une couche unifiée de données structurées et non structurées pour alimenter les agents. ServiceNow a racheté Data.World pour acquérir un catalogue de données et une gouvernance sémantique. SAP pousse Joule, son assistant IA natif connecté directement aux données ERP. Rien de cosmétique là-dedans. Des repositionnements d’éditeurs qui ont compris que leur survie tient à la profondeur de leur ontologie.

Le modèle économique va simplement évoluer : les SaaS vendront moins leurs fonctionnalités logicielles et davantage l’accès à leur ontologie — c’est-à-dire au contexte dont les agents ont besoin pour opérer sans halluciner. Et cette ontologie constitue une barrière à l’entrée redoutable pour tout nouvel entrant : construire en deux ans ce que Salesforce a accumulé en vingt-cinq n’est pas une option. L’ère agentique ne détruit pas les SaaS installés — elle consolide leur avantage concurrentiel à condition qu’ils en comprennent la nature.

Le test opérationnel est le MCP. Un éditeur qui publie un serveur MCP riche — avec ses intégrations, son historique, son contexte métier — signale que son ontologie a de la valeur et peut alimenter n’importe quel agent. Celui qui ne publie pas annonce implicitement que son logiciel peut être contourné.

L’avenir appartient à celui qui a le « compute »

Le 20 avril 2026, Anthropic publie une annonce qui résume à elle seule la nouvelle économie de l’IA. L’entreprise s’est engagée à dépenser plus de $100 milliards sur AWS sur dix ans — soit cinq fois son chiffre d’affaires annualisé de mars 2026 ($19 milliards, multiplié par 19 en quinze mois) — en échange de l’accès à jusqu’à 5 gigawatts de compute pour l’entraînement et le déploiement de Claude. En retour, Amazon investit jusqu’à $25 milliards en capital (dont $5 milliards immédiats) à une valorisation de $380 milliards. Près d’1 gigawatt de Trainium2 et Trainium3 sera opérationnel d’ici fin 2026.

La nature de cet accord est révélatrice. Anthropic — modèle de référence sur les usages enterprise, $19 milliards de revenus annualisés — n’est pas en position de force : c’est Anthropic qui a besoin du compute d’Amazon, pas l’inverse. L’intelligence, si brillante soit-elle, sans GPU pour tourner n’est qu’un algorithme sur papier. Le compute est devenu la ressource scarce.

La demande pour jouer l’arbitrage décrit dans cet article est si forte que le compute est en rupture structurelle. Les dépenses d’investissement des hyperscalers atteignent $660–690 milliards en 2026, dont 75% ($450 milliards) fléchés vers l’infrastructure IA. Le paradoxe de Jevons s’applique ici : l’amélioration de l’efficacité d’une ressource accroît sa consommation totale. Chaque baisse du coût du token ouvre de nouveaux cas d’usage, qui génèrent de nouveaux volumes.

Quatre positions dans la guerre du calcul:

La rareté de la puissance de calcul redistribue les cartes. Quatre stratégies émergent.

Microsoft et Google jouent les deux côtés. Ils vendent le compute (Azure, Google Cloud) et construisent leurs propres services IA (Copilot, Gemini Enterprise). Pour OpenAI — structurellement dépendant d’Azure — la situation est inconfortable : son principal fournisseur est devenu son concurrent direct sur le segment enterprise. D’où la diversification impérative : le projet StarGate ($500 milliards avec SoftBank) vise à lui donner une infrastructure propriétaire, indépendante de Microsoft.

Amazon loue l’infrastructure sans fermer l’arbitrage lui-même. AWS est fournisseur de compute, pas concurrent des entreprises qui déploient des agents. L’accord Anthropic illustre le modèle : Amazon capte à la fois les revenus cloud ($100 milliards sur dix ans) et l’upside en capital ($25 milliards de mise pour une part d’une société à $380 milliards). Stratégie de plateforme pure : laisser les autres jouer l’arbitrage, se rémunérer sur le volume.

Les neoclouds prospèrent dans la pénurie. En situation de shortage structurel de GPU, chaque gigawatt de capacité supplémentaire se loue à prime. CoreWeave, Lambda Labs et leurs équivalents européens comblent l’écart entre les hyperscalers saturés et les entreprises qui ont besoin de compute immédiat. La pénurie n’est pas un accident — elle est la conséquence prévisible d’une demande qui croît plus vite que les délais de construction des datacenters (18 à 36 mois de cycle).

Google et Meta financent l’IA grand public par la publicité. Sans concurrent dominant sur l’IA à destination du consommateur (ChatGPT et Claude sont des abonnements payants), les deux acteurs peuvent déployer des modèles avancés à coût marginal nul pour l’utilisateur final. Gemini intégré dans Search atteint 1,5 milliard d’utilisateurs sans friction. Meta AI déployé sur WhatsApp, Instagram et Facebook touche 3,3 milliards d’actifs mensuels. La masse de données comportementales générées referme le flywheel publicitaire tout en alimentant l’entraînement des modèles. Sur ce terrain, OpenAI et Anthropic ne peuvent pas suivre.

jouer l’arbitrage est un travail

L’arbitrage décrit dans cet article n’est pas un gain automatique. Le capturer exige trois choses : la volonté stratégique de l’engager, une direction claire sur les processus à transformer en priorité, et une exécution dans le détail — intégration des systèmes, gouvernance des ontologies, audit qualité, réorganisation des workflows humains autour des agents.

Tant que l’arbitrage reste ouvert, chaque entreprise qui l’a engagé a besoin de talents pour l’exécuter, et chaque entreprise qui ne l’a pas encore engagé a besoin de talents pour le comprendre. Le marché du travail IA en 2025–2026 le confirme : offres en “prompt engineering” +135,8% sur douze mois, “AI engineer” +143%, salaire moyen $206 000 en 2025 aux États-Unis. Gartner estime que 40% des applications enterprise intégreront des agents task-specific d’ici fin 2026, contre moins de 5% en 2025.

Bastiat avait raison sur ce point aussi : les effets indirects créent des emplois que l’analyse superficielle ne voit pas. L’arrivée du robot de soudure n’a pas supprimé l’emploi dans l’automobile — elle a déplacé la compétence vers la programmation, la maintenance et la conception.

L’arbitrage se refermera quand la totalité des processus automatisables l’aura été (le surplus sera alors pour le consommateur. Ce n’est pour demain. D’ici là, la vitrine cassée de Bastiat aura bien été réparée — et pas par le vitrier qu’on imaginait.

Bonne semaine,

Hervé

Très dense et très riche, merci pour cet article.

Quel avenir vois-tu à la workforce des entreprises clientes d'OpenAI, Anthropic, Mistral, etc. quand l'arbitrage disparaîtra ? Licenciement massif ? Déplacement des cols blancs vers les géants de la tech ? Ou comme la direction qu'imagine Naval Ravikant, chaque personne a son micro business (a world with 7 billion businesses) ?

L’arbitrage pour moi disparaîtra par la force de la concurrence, quand le prix marginal des biens rejoindra leur coût marginal, quand les entreprises auront adopté la technologie en masse. Dès lors, le surplus sera pour les consommateurs qui, les hommes étant ce qu’ils sont, chercheront toujours à se différencier en possédant ce que les autres n’ont pas. Cela donnera de nouveaux besoins et de nouveaux business.

Quant au type de gagnants, il n’est pas dit que ce soit forcément des petits business. La question centrale est l’agilité. Les grosses sociétés peuvent gagner beaucoup par l’agentique en réduisant fortement leur faiblesse chronique: la bureaucratie et gagner la bataille de l’échelle. Le jeu est ouvert…